こんにちは。居宅介護支援事業所で一人ケアマネをしているヒトケアです。

はじめての方は、「ヒトケアの仕事術」活用ガイドをご覧ください。

生成AIを活用したいのですが、個人情報の漏洩が恐くて使えません。

皆さんは、日頃ChatGPTなどの生成AIを活用されていますでしょうか?

プライベートでは使ったことがあるけれど、ケアマネ業務となると、

「個人情報をどう守ればいいのか分からない」

という不安から、一歩を踏み出せない方も少なくありません。

私も研修講師で生成AIの活用を紹介すると、毎回のように、

「利用者さんの個人情報はどう扱えば安全ですか?」

という質問をいただきます。

生成AIは便利な一方、使い方を誤ると利用者・家族の大切な情報をリスクにさらしてしまいます。

だからこそ、正しい向き合い方を押さえたうえで活用することが重要です。

そこで今回の記事では、ケアマネジャーが無料版の生成AIでも個人情報を守りながら安心して使う方法を、現場で実践しやすい手順で解説します。

ケアマネ業務に生成AIを活用したい方は、ぜひご覧ください。

ケアマネ業務における生成AIの活用法は、以下の記事をご覧ください。

1.【そもそも論】“個人情報”とは何か?

いまさらですけど、“個人情報”とは何かを知りたいです。

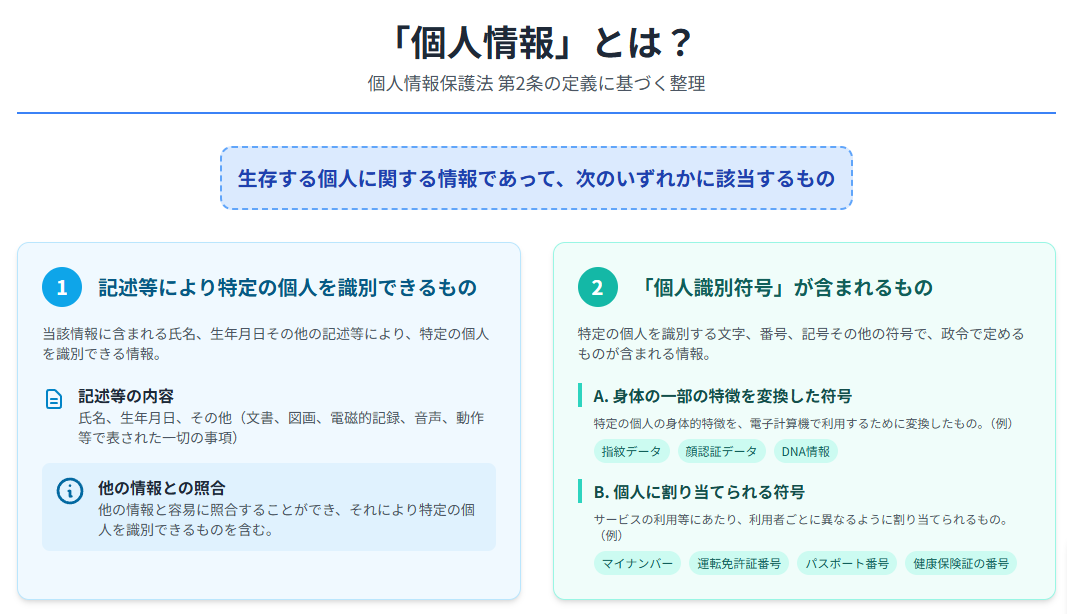

「個人情報」とは、特定の誰かを識別できる情報のことです。

「個人情報の保護に関する法律(個人情報保護法)」では、個人情報について次のように定義されています。

(定義)

引用元:個人情報の保護に関する法律

第二条 この法律において「個人情報」とは、生存する個人に関する情報であって、次の各号のいずれかに該当するものをいう。

一 当該情報に含まれる氏名、生年月日その他の記述等(文書、図画若しくは電磁的記録(電磁的方式(電子的方式、磁気的方式その他人の知覚によっては認識することができない方式をいう。次項第二号において同じ。)で作られる記録をいう。以下同じ。)に記載され、若しくは記録され、又は音声、動作その他の方法を用いて表された一切の事項(個人識別符号を除く。)をいう。以下同じ。)により特定の個人を識別することができるもの(他の情報と容易に照合することができ、それにより特定の個人を識別することができることとなるものを含む。)

二 個人識別符号が含まれるもの

2 この法律において「個人識別符号」とは、次の各号のいずれかに該当する文字、番号、記号その他の符号のうち、政令で定めるものをいう。

一 特定の個人の身体の一部の特徴を電子計算機の用に供するために変換した文字、番号、記号その他の符号であって、当該特定の個人を識別することができるもの

二 個人に提供される役務の利用若しくは個人に販売される商品の購入に関し割り当てられ、又は個人に発行されるカードその他の書類に記載され、若しくは電磁的方式により記録された文字、番号、記号その他の符号であって、その利用者若しくは購入者又は発行を受ける者ごとに異なるものとなるように割り当てられ、又は記載され、若しくは記録されることにより、特定の利用者若しくは購入者又は発行を受ける者を識別することができるもの

生成AIの活用で注意すべき「個人情報」には、大きく分けて2つのレベルがあります。

レベル1:それだけで「誰か」がわかる情報

まず、法律(個人情報保護法)でも定められている、最も基本的な個人情報です。

- 氏名

- 住所

- 電話番号

- マイナンバー

- 顔写真 など

レベル2:組み合わせると「誰か」がわかってしまう情報

一つ一つは個人情報でなくても、複数組み合わせることで「この人だ」と分かってしまう情報のことを指します。

例えば、以下の5つの情報をバラバラに見れば、個人は特定できません。

- 82歳

- 男性

- 江東区在住

- 週3回、◯◯デイサービスを利用

- 2024年9月4日に間質性肺炎で入院

しかし、これらをすべて組み合わせると、その地域や関係者が見れば、

「ああ、あの方のことだ」

と分かってしまう可能性があります。

このように、複数の情報の組み合わせで個人が特定できてしまうものも、慎重に扱うべき「個人情報」なのです。

2.なぜ生成AIに個人情報を入れてはいけないのか?

そもそも、なぜ生成AIに個人情報を入れてはいけないのですか?

それは、生成AIが持つ“仕組み”にあります。

ここでは特に知っておくべき2つの大きなリスクについてお伝えします。

リスク1:AIが「学習」して、他人に話してしまう

一つ目のリスクは、AIが入力された情報を「学習」してしまうことです。

生成AIは、まるで新人スタッフのように、教えられたことや会話した内容をどんどん吸収して賢くなっていきます。

サービスの品質向上のため、私たちが入力した文章もその学習データの一部として使われることがあるのです。

利用者Aさんや家族の実名、住所、ケアプランの詳細などをAIに入力してしまったとします。

後日、まったく別の誰かが「介護サービスの事例を教えて」とAIに質問した際に、AIが学習したAさんの個人情報を、事例の一部としてポロッと回答に含めてしまう…なんてことが起こりかねないのです。

一度AIが覚えてしまった情報を完全に忘れさせるのは、非常に困難です。

これが、生成AI特有の最も注意すべきリスクです。

リスク2:システムからの「情報漏洩」

二つ目のリスクは、私たちが普段使っている他のインターネットサービスと同じように起こり得る「情報漏洩」です。

私たち生成AIに入力したデータは、AIの頭の中だけでなく、サービスを提供している会社のコンピューター(サーバー)に保存されています。

ここには、主に2つの危険が潜んでいます。

- 外部からの攻撃

悪意のある人がサーバーに侵入し、保存されているデータを盗み出してしまう可能性があります。 - システムの不具合や人のミス

プログラムの誤作動や設定ミスによって、本来見えてはいけない情報が他の人に見えてしまうケースです。

ケアマネジメントでは、利用者の氏名や住所、生活歴といった極めて重要な個人情報を取り扱います。

万が一、こうした情報が漏洩してしまった場合、利用者からの信頼を失うだけでなく、大きな問題に発展する可能性があります。

3.今日からできる!生成AIを安全に使う3つのルール

AIが覚えてしまうリスクと、システムから漏れてしまうリスクがあるんですね。

ケアマネ業務で生成AIを使うのが恐くなってきました。

次に紹介する3つのルールを守れば、生成AIを安全に活用できます。

ルール1:学習に利用させない設定を必ずON

先ほど、生成AIでは入力した内容がサービス改善のために扱われる場合があるとお伝えしました。

そのため、個人情報を入力した場合、将来ほかの回答の中に似た形で表に出てしまう可能性があります。

しかし、最初に「学習に利用させない設定」 をしておけば、そのリスクを防ぐことができます。

この設定を「オプトアウト設定」といいます。

ChatGPTとGeminiのオプトアウト設定は、以下のとおりです。

ChatGPTの場合

これで、入力した内容が学習やサービス改善に利用されることを防ぐことができます。

一度設定してしまえば、その後は特に繰り返し操作する必要はありません。

Geminiの場合

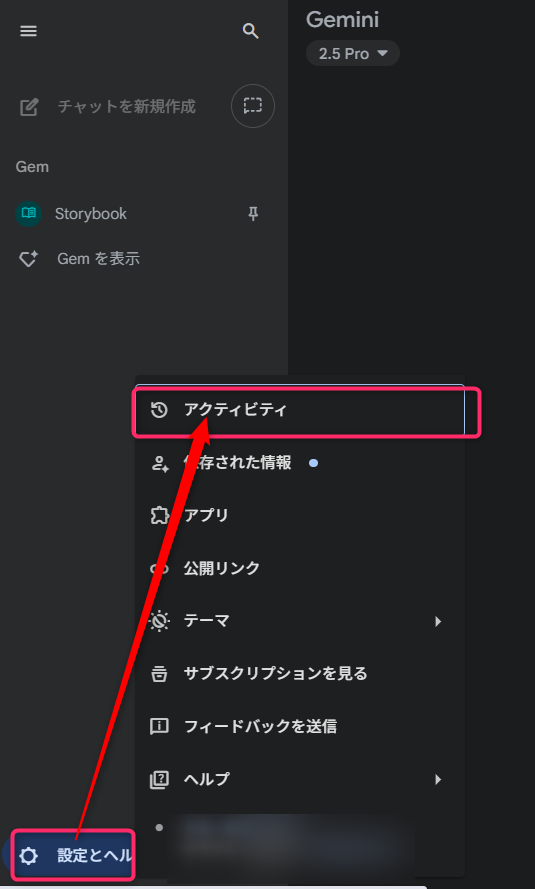

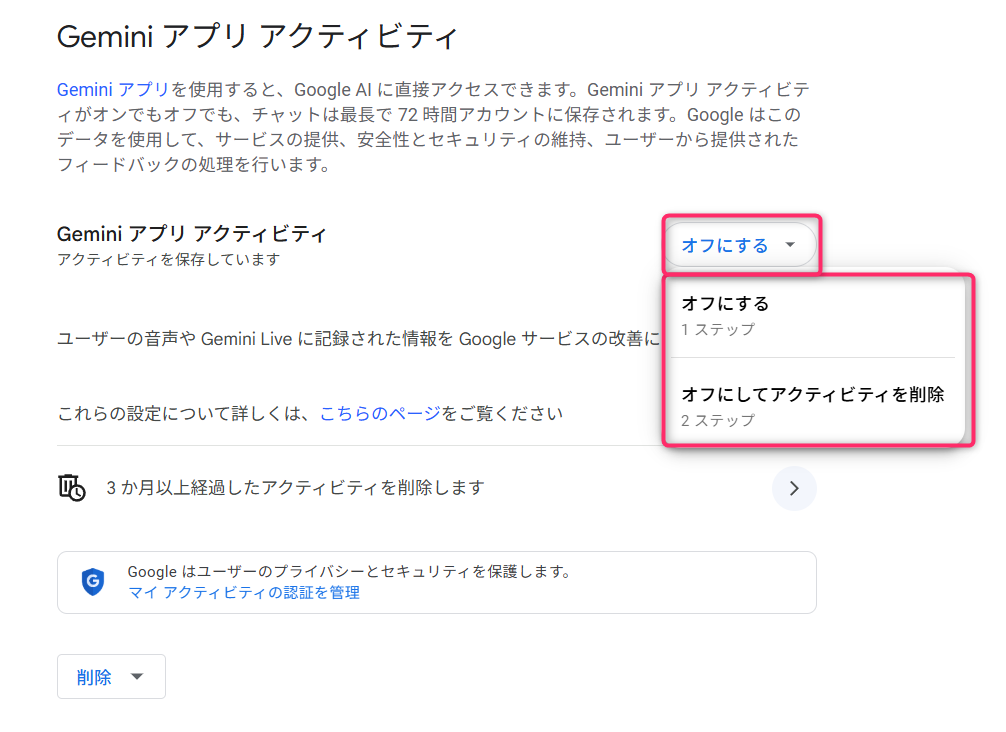

- 左下のメニューから 「設定とヘルプ」 をクリックし、表示される項目の中から 「アクティビティ」 を選びます。

- 「Gemini アプリ アクティビティ」の画面が開きます。

- 右上のプルダウンをクリックして 「オフにする」 を選びましょう。

- さらに確実に削除したい場合は、 「オフにしてアクティビティを削除」 を選択すると、これまでの保存データもまとめて消すことができます。

ChatGPTと同様に、最初に一度だけ設定しておけば、その後は安心して利用できます。

ルール2:固有名詞(人・場所・組織名)は絶対に削除

AIに学習に利用させない設定をしておけば、個人情報は入力しても大丈夫ですか?

いいえ、それでも固有名詞は入力してはいけません。

なぜなら、前述のルール1のオプトアウト設定は、あくまでもAIの学習(再学習)への利用を止める仕組みだからです。

入力した内容そのものは一時的にサーバーに保存され、以下の目的で扱われる可能性があります。

- サービスを動かすための処理

- 不正利用の監視

- システム障害の調査

この間に、サービス改善や不具合対応のために一部のスタッフが確認する場合や、万が一システムが不正アクセスを受けて外部に流出する危険もゼロではありません。

だからこそ、氏名・住所・施設名などの固有名詞は必ず削除して入力することが重要なのです。

ルール3:「この人だ」と分かる表現をぼかす

では、利用者さんの氏名や住所などの個人情報を入力しなければ問題ないですか?

いいえ、名前などの直接的な個人情報を消すだけでは、まだ不十分なんです。

まずは、以下の入力例をご覧ください。

82歳の女性。要介護2。週3回、◯◯市△△町の▢▢デイサービスを利用。2025年7月20日に間質性肺炎で△△病院へ救急搬送され入院。8月7日の退院後は在宅酸素を使用しながら、長男と二人暮らし。

このように、名前や住所を消していても、年齢・地名・施設名・病名・日付・利用頻度・家族構成といった情報を細かく並べてしまうと、複数の情報がパズルのピースのように組み合わさり、読む人によっては「誰のことか」がわかってしまいます。

だからこそ、情報はそのまま入力せず、少しぼかして表現する工夫が必要になります。

80代前半の女性。要介護2。週に数回、市内のデイサービスを利用。昨夏に呼吸器系の病気で入院。退院後は在宅酸素を使用しながら、家族と二人暮らし。

このように少しぼかして表現することで、状況を伝えつつも「この人だ」と特定されるリスクを大きく下げることができます。

全ての情報をぼかす必要があるのですか?

いいえ、全ての情報をぼかす必要はありません。

大切なのは「安全性」と「AI回答の精度」のバランスです。

AIに考えてもらうために重要な情報、たとえば病名や介護度などは、具体的に入力したほうが適切な答えが得られます。

ただし、年齢・住所・日付・家族構成などを細かく組み合わせると「この人だ」と分かってしまうリスクが高まります。

そのため、

「回答の精度に関わる情報は具体的に、個人の特定につながる背景は抽象的に」

というバランスが大切です。

例えば、質問の目的上、病名が不可欠な場合はそのまま書き、その分、年齢や地域はぼかすことで、安全と実用性を両立できます。

4.無料版とビジネス版の違いを知っておこう

ChatGPTやGeminiなどの生成AIには、「無料版」と「ビジネス版」があります。

ここでは、両者の違いについて説明します。

無料版:特徴と注意点

無料版の生成AIは、アカウントを作成すれば誰でもすぐに利用できる手軽さが魅力です。

ただし注意すべき点があります。

無料版では、入力した内容がサービス改善のために扱われる場合があるのです。

つまり、会話の一部がAIを提供している会社のサーバーに残り、品質向上の参考にされることがあります。

このため、利用者や家族の名前・住所・病歴などの個人情報をそのまま入力することは避けなければなりません。

ビジネス版:メリットと課題

ビジネス版の生成AIは、企業や組織向けに提供されているサービスです。

最大の特徴は、入力した内容がAIの学習やサービス改善に利用されないと契約で保証されていることです。

また、厳重なセキュリティのもとで管理されるため、リスクを大幅に下げることができます。

そのため、無料版に比べて個人情報や機密情報の取り扱いに関して、より安心して利用できる環境が整っています。

一方で、ビジネス版には次のような課題もあります。

- 月額費用が発生するため、個人や小規模事業所では導入ハードルが高い

- 契約や設定が必要で、すぐに使い始められる無料版と比べると手間がかかる

私の事業所ではビジネス版の導入は難しそうです。

ビジネス版は安心感がありますが、コストや導入のハードルを考えると現実的ではない事業所も多いと思います。

だからこそ、無料版を使いながらも「学習に利用させない設定」「固有名詞の削除」「表現をぼかす」という3つのルールを守ることが大切です。

この工夫さえすれば、無料版でも十分に安全にAIを活用することができます。

5.まとめ:正しく恐れて、生成AIを頼れるパートナーにしよう!

今回の記事では、ケアマネ業務における生成AIを安全に活用するための方法について、ご紹介しました。

ポイントは次の3つです。

これらのルールを押さえることで、利用者の大切な個人情報を守りながら、生成AIを安心して業務に取り入れることができます。

私自身、ケアマネ業務に生成AIを活用するようになってから、効率的かつ質の高い記録文やケアプランの作成ができるようになりました。

さらに、一人ケアマネとして支援を抱え込んでしまいがちなときでも、生成AIを“壁打ち相手”として使うことで新しい気づきを得られることもあります。

生成AIを「恐いから使わない…」と避けるのではなく、正しく恐れて、上手に活用することが重要です。

そうすれば、生成AIは皆さんの仕事を支える頼れるパートナーになります。

ぜひ明日から、業務の一部に少しずつ取り入れてみてください。

私も生成AIの設定や入力に気をつけたうえで、生成AIを活用していきます!

AIによる分析もできるアセスメントシートは、以下の記事にて紹介しています。

コメント